16.12.2016

Die Gefahren durch Social Bots – Dossier 3, Beitrag #2

ArbeitssuchendeBerufstätigeBlogDossier 3 - GesellschaftDossiersElternKinder / JugendLehrende / PädagogInnenSchulklassenSeniorInnen

Social Bots stellen durch die Einflüsse, die sie bewirken können, eine Gefahr für die Demokratie dar. Was genau sind Social Bots? Welche konkreten Gefahren können von ihnen ausgehen, auch für Österreich? Und was kann dagegen unternommen werden?

Was sind Social Bots?

Ein Bot (von Robot) ist ein Computerprogramm, dass je nach Vorgabe seines Programmierers bestimmte, sich wiederholende Aufgaben erledigt. Mit dem Zusatz Social werden Bots bezeichnet, die in vorzugsweise sozialen Netzwerken wie Facebook, Twitter oder Instagram agieren. Sie versuchen meist, ihre Identität zu verschleiern, wollen weitestgehend menschlich erscheinen, wie echte Nutzer.

Dabei ist der Grundgedanke hinter Social Bots vollkommen harmlos und legitim: Sie sind sehr hilfreich, wenn es beispielsweise darum geht, mit vielen Nutzern sozialer Netzwerke in kurzer Zeit zu interagieren, spezifisch nach der gewünschten Zielgruppe Beiträge zu erstellen oder Follower regelmäßig auf neue Publikationen hinzuweisen. So haben zum Beispiel die Blogger von netzpolitik.org einen Social Bot programmiert, der regelmäßig prüft, ob auf der eigenen Website ein neuer Beitrag veröffentlicht wurde. Der Bot postet anschließend jeden Beitrag automatisch auf Twitter. Er nimmt also potenzielle Arbeit ab.

Es ist sehr einfach, einen Social Bot zu erstellen. Für Twitter benötigt man einen Nutzeraccount, einen Zugang zur automatisierten Schnittstelle (API) des sozialen Netzwerks und ein Programm, das in der Lage ist, einen Account automatisiert steuern zu lassen. Außerdem gibt es zahlreiche Anleitungen im Internet, die auch für Laien das Programmieren von Bots so einfach wie möglich gestalten sollen.

Welche Gefahren können von Social Bots ausgehen?

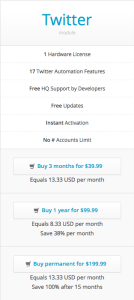

Bedenklich wird der Einsatz von Social Bots, wenn sie zur automatisierten Propaganda missbraucht werden. Schließlich ist es möglich, mit einem einzigen Computerprogramm mehrere hundert oder sogar tausend Fake-Accounts für Twitter zu steuern. Das richtige Tool dafür kostet ca. 200 $, die nötigen Accounts sind ebenfalls online erhältlich.

Für 80 $ kann man sich 1.000 Twitter-Profile kaufen, für 20 $ mehr sogar jeweils mit Profilbild- und -beschreibung, damit sie möglichst menschlich wirken und als Fake Accounts nicht so schnell auffliegen.

Der Politologe Simon Hegelich geht in einer Studie der Konrad Adenauer Stiftung davon aus, dass Social Bots vor der Brexit-Abstimmung in Großbritannien und während der Krim-Annexion mitten im Ukrainekonflikt mitgemischt und erheblichen Einfluss auf Debatten ausgeübt haben. Dabei merkt er an, dass die künstliche Intelligenz, die sich hinter den Bots verbirgt, immer komplexer und schlauer wird. Vereinzelt können Social Bots wie echte, menschliche Nutzer erscheinen, indem sie einen Tag-Nacht-Rhythmus vortäuschen, viele Follower aufweisen, überwiegend Beiträge zu eher nebensächlichen Themen veröffentlichen und sogar mit Menschen im Chat kommunizieren können. Gleichzeitig aber, am Beispiel des Ukrainekonflikts zu sehen, gemischt mit politisch-rechten Inhalten.

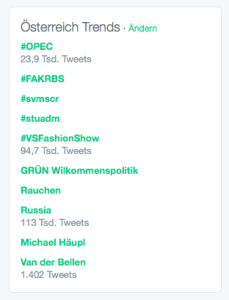

Social Bots sind dabei eine große gesellschaftliche Gefahr, denn durch die Möglichkeit, mit einem einzigen Computerprogramm mehrere tausend Bots zu kontrollieren, können gesellschaftliche Meinungen beeinflusst werden. Durch Likes und Retweets (die maßgeblichen Kenngrößen für Erfolg und Reichweite auf Twitter) können die sogenannten „Trending Topics“, also die Ranglisten mit den Begriffen, die in dem sozialen Netzwerk aktuell am häufigsten Verwendung finden, beeinflusst werden.

So wurden auch während des letzten US-Wahlkampfs Social Bots eingesetzt, die meisten schätzungsweise aus dem Trump-Lager. Als die erste TV-Debatte zwischen Hilary Clinton und Donald Trump vorbei war, stieg der Hashtag #Trumpwon („Trump hat gewonnen“) schnell in den Trending Topics bei Twitter auf, während viele Zuschauer und vor allem die Presse Trump als deutlichen Verlierer der Debatte einstufte. So wurde in dem sozialen Netzwerk das gesellschaftliche Bild deutlich verzerrt. Wer die Debatte nicht sah und nur einen Blick auf den Twitter-Trend warf, war vermutlich der Ansicht, Trump wäre aus der TV-Debatte als deutlicher Sieger hervorgegangen.

Eine kurz vor der Wahl veröffentlichte Studie von Alessandro Bessi und Emilio Ferrara der University of Southern California gab Schätzungen ab, dass während des Wahlkampfs knapp 400.000 Bots auf Twitter mitgemischt haben. Sie veröffentlichten 3,8 Millionen Tweets, wobei ungefähr 75% von ihnen für Donald Trump twitterten und nur 25% für Hilary Clinton. Eine weitere Studie von Bence Kollanyi, Phillip N.Howard und Samuel C. Woodley, die knapp 10 Tage nach der Präsidentschaftswahl 2016 erschien, stellt außerdem fest: Social Bots aus dem Trump-Lager waren besonders aktiv zu strategisch wichtigen Ereignissen, beispielsweise während und nach den jeweiligen TV-Debatten und kurz vor der eigentlichen Wahl am 8. November.

Das gefährliche dabei: Durch das Verfälschen oder Verstärken von Trends lassen sich viele Menschen indirekt beeinflussen. Oft schließen sie sich der Meinung an, die tendenziell die meiste Zustimmung erhält. Deshalb ist es in Österreich beispielsweise verboten, erste Auszählungen und Wahlprognosen am Tag der Nationalratswahl vor Schließung der Wahllokale zu veröffentlichen, damit die Wahlergebnisse nicht durch psychologische Faktoren beeinflusst werden können. Dass im Falle von Social Bots viele natürlich nicht erkennen, dass es sich bei ihnen gar nicht um die Meinung echter Menschen handelt, macht die Sachlage umso gefährlicher. Während der Brexit-Debatte konnte festgestellt werden, dass Tweets mit dem Hashtag #Brexit häufig von Bots stammten. Ein Großteil davon wurde dem konservativen Lager zugeschrieben, das für einen Austritt aus der Europäischen Union war. Social Media-Trends fließen außerdem in wirtschaftliche und politische Entscheidungsprozesse ein. Durch die Analyse von vermeintlich präsenten Meinungen in sozialen Netzwerken passen Unternehmen ihre Marketingstrategien und Politiker ihre Programme an. So können Social Bots zu einer Gefahr für die Gesellschaft und schließlich auch für die Demokratie werden.

Propaganda-Roboter auch in Österreich?

Bisher gibt es keine Anzeichen dafür, dass Social Bots zu Propagandazwecken in Österreich eingesetzt werden. Doch auch hier besteht potenziell die Gefahr, dass gesellschaftliche Debatten gezielt beeinflusst werden können. So kann die aktuelle Flüchtlingsdebatte und die gesellschaftliche Meinung dazu in gewissen Maßen gelenkt werden, wenn Social Bots zum Beispiel in großem Umfang den Hashtag #refugeesnotwelcome („Flüchtlinge nicht willkommen“) auf Twitter benutzen, während die österreichische Gesellschaft doch eher zu einer offenen Willkommenskultur tendiert. Auch hier würde gelten: Der Eindruck, der durch die verfälschten Trends in sozialen Medien entstehen kann, ist gefährlich für Politik, Medien und Gesellschaft.

Was kann gegen den Einfluss unternommen werden?

Social Bots werden nicht mehr verschwinden. Algorithmen und künstliche Intelligenzen sind Teil der Gesellschaft und gehen mit der digitalen Transformation einher. Den Betreibern sozialer Netzwerke gelingt es außerdem bisher nicht, alle unerwünschten Bots von ihren Plattformen zu verbannen.

Die Methoden der Erkennung von Propaganda-Robotern in sozialen Medien, beispielsweise durch spezielle Tools für die Nutzer, werden stetig optimiert und besser. Doch gleichzeitig wird auch die Programmierung von Propaganda-Robotern intelligenter und komplexer. Es gilt: Je menschlicher ein Social Bot agiert und sich verhält, desto schwieriger wird es, ihn als einen solchen zu erkennen.

Schon jetzt ist es nahezu unmöglich, alle Bots, die sich in sozialen Netzwerken tummeln, zu identifizieren. Über die Anzahl gibt es höchstens Schätzungen. Viel schwieriger ist es überdies, die Drahtzieher hinter den Kulissen auszumachen. Niemand weiß, wer die Bots steuert, die etwa für Donald Trump Propaganda machen. Und auch der tatsächliche Einfluss, der sogenannte „Bot-Effekt“ (Simon Hegelich), den Social Bots auf die gesellschaftliche Meinung haben, ist empirisch nicht nachvollziehbar oder gar messbar.

Wichtig ist daher vor allem, dass politische Akteure und Internetnutzer der potenziellen Gefahren durch das mögliche Verfälschen von Social Media-Trends sensibilisiert sind und einen verantwortungsvollen und aufgeklärten Umgang mit Algorithmen und künstlicher Intelligenz vermitteln. Auch sollte klar sein, dass quantitative Parameter wie „gefällt-mir-Angaben“ auf Facebook, Retweets, die Anzahl an Followern und Erwähnungen von Schlüsselwörtern auf Twitter keine Maßeinheiten für Qualität und gesellschaftliche Meinungstendenzen sind. Social Bots sind in sozialen Netzwerken allgegenwärtig. Ein Verantwortungsvoller und kritischer Umgang mit neuen Medien und Informationen im Internet, vor allem in sozialen Netzwerken, ist daher unerlässlich.

Bilder:

– Twitter Trends: Screenshot twitter.de

– Fake-Profile kaufen: Screenshot http://www.buysocialaccountz.com/twitter-accounts

– Twitter Tool: Screenshot: http://monstersocial.net

WerdeDigital.at

Institut zur Förderung digitaler Mediennutzung